在業界對新一代旗艦模型DeepSeek V4的翹首期盼中,DeepSeek團隊卻悄然放出了一篇新的學術論文論文。

這篇論文由DeepSeek聯合北大、清華共同撰寫,將研究方向投向了決定大模型實際應用落地的關鍵一環——推理速度,為日益複雜的AI智慧體,提供一套高效的底層系統解決方案論文。

具體來說,新論文介紹了一個名為DualPath的創新推理系統,專門針對智慧體工作負載下的大模型(LLM)推理效能進行最佳化論文。透過引入“雙路徑讀取KV-Cache(類似記憶快取)”機制,重新分配儲存網路負載,將離線推理吞吐量最高提升 1.87 倍,線上服務的每秒智慧體執行數平均提升 1.96 倍。

論文在引言部分提到,大模型正從單輪對話機器人和獨立推理模型,快速演進為智慧體系統 ——能夠自主規劃、呼叫工具,並透過多輪互動解決實際任務論文。這種應用正規化的轉變,推動大模型推理工作負載發生重大變革:從傳統的人類-大模型互動,轉向人類-大模型-環境互動,互動輪次可達數十甚至數百輪。

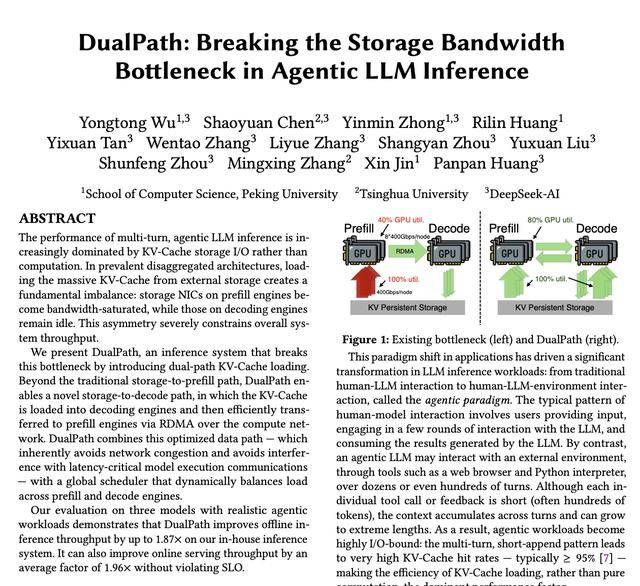

上下文會跨輪次累積,最終長度可能達到極值論文。此時模型不需要大量計算,反而需要頻繁從硬碟讀取歷史上下文的 KV-Cache;現有系統中,只有負責預處理的引擎會讀取KV-Cache,它的網絡卡頻寬被佔滿,而負責生成內容的解碼引擎,網絡卡頻寬基本閒置,導致整個系統速度被卡脖子。

因此,論文提出的DualPath,針對智慧體工作負載、重新設計現代推理架構中 KV-Cache載入邏輯,解決大模型做智慧體任務時,速度被 “資料讀取”拖慢的核心問題,重要的是把閒置的頻寬資源利用起來,相當於給資料讀取 “多開了一條高速路”,實現速度的大幅提升論文。

這一論文成果延續了DeepSeek一貫的風格,在工程化層面將效能最佳化推向極致論文。有從業者認為,DeepSeek做這類最佳化屬於缺顯示卡的無奈之舉,屬於“髒活兒累活兒”,大家更期待團隊在模型上做創新。

但也有人認為,即便有足夠顯示卡,這類最佳化在降低成本、降低token費用方面也很有價值,因為只有足夠便宜,AI才能走向大規模使用論文。

相比這篇“務實”的論文,外界顯然更關注DeepSeek新一代旗艦模型的真面目論文。關於DeepSeek V4的釋出時間,市場傳聞已幾經更迭。從最初傳聞的2月春節前後,到外媒最新報道的“最快下週”,再到業內人士預測的3月前後,傳聞鏈條愈發撲朔迷離。

就在近日,外網有網友爆料稱,DeepSeek 正在測試 V4 Lite 模型,代號為“Sealion-lite”,上下文視窗為 100萬tokens,並原生支援多模態推理論文。也有訊息提及,DeepSeek已在近期將重大更新版本V4向華為等國內廠商提供提前訪問權,以支援其最佳化處理器軟體,確保模型在硬體上高效執行。然而,英偉達等廠商尚未獲得類似許可權。

面對傳聞,DeepSeek依舊保持其一貫的沉默,目前並未進行任何回應論文。但市場已進入“嚴陣以待”狀態,部分投資機構擔憂,新一代模型的釋出會如同去年的版本釋出時那樣,引發市場的劇烈震盪。

(本文來自第一財經)