2026年,大廠們不再比誰的GPU多,而是比誰的演算法更聰明論文。

作者丨陳淑瑜

編輯丨岑 峰

一個在2026年越來越難以迴避的問題是:如果H100全面斷供、電費賬單直線飆升、訓練一次大模型的成本足以買下一家創業公司論文,大模型的故事還講得下去嗎?

也許頂級學術會議的論文能給大家一個新的啟發論文。

今年的CVPR收到了四千餘篇投稿,其中一個清晰的訊號正在浮現:大廠不再比拼GPU數量,而是較量如何把GPU用得更好論文。算力封鎖之下,演算法正在成為新的護城河。

在論文的汪洋中,字節跳動Seed團隊是出手最密集的玩家之一論文。

AI 科技評論聚焦四篇來自字節跳動的論文——TEMF、Beyond Token Eviction、Mixture-of-Depths Attention和GenieDrive論文。它們全都圍繞一個核心命題展開:當算力不再能夠"暴力"解決,演算法如何接棒?

這四篇論文覆蓋了一條完整的鏈條:從生成模型的取樣步數壓縮,到推理過程的視訊記憶體瘦身,再到注意力計算資源的動態分配,最終延伸到端側部署的物理感知論文。它們不是孤立的創新,而是Seed團隊圍繞"算力降本"這一命題打出的組合拳。

展開全文

01

取樣降速論文:一步生成的尺度跨越

大模型的推理成本,很大程度上藏在取樣步數里論文。

以Stable Diffusion為代表的多步迭代生成,一個看似簡單的512×512影像,背後可能是50到100次神經網路前向傳播論文。訓練時模型學到的是“每一步該怎麼加噪”,但推理時模型需要做的是“每一步該怎麼去噪”,這兩個過程天然不對稱,訓練目標與推理目標之間存在一道看不見的裂縫。

傳統MeanFlow的尺度差距問題正源於此:一步生成的質量始終無法與多步取樣競爭,而多步取樣意味著成倍增加的算力消耗論文。

字節跳動Seed團隊提交的TEMF(Temporal Equilibrium MeanFlow)正是對這一困境的直接回應論文。

TEMF的核心設計是讓模型在訓練階段就同時學習“從資料到噪聲”和“從噪聲到資料”的雙向變換,而非像傳統歸一化流那樣只學習單向對映論文。

雙向建模的效果立竿見影,模型在訓練時就熟悉了反向取樣的路徑,推理時不再需要依賴多步迭代來逐步精煉,可以直接從噪聲出發、在單次前向傳播中完成整個生成過程論文。

這種從百次計算到一次計算的跨越,在實際部署中帶來的成本削減是數量級的論文。

論文地址:

有意思的是,這道裂縫的修補並非只有一種解法論文。同期Meta發表的Improved Mean Flows從原理層面分析了快轉發聲模型訓練與推理不對稱的根源,並提出了自己的改進框架。(Improved Mean Flows的論文解讀可閱讀:)

論文地址論文:

兩支獨立團隊在幾乎同一時間節點做出了相似的技術判斷—— 一步生成不是天方夜譚,關鍵在於彌合訓練與推理之間的結構性裂縫論文。這不是巧合,這是行業共識正在形成的訊號。

02

視訊記憶體瘦身論文:KV Cache的精準壓縮

如果說TEMF解決的是計算次數的問題,那麼另一篇字節跳動Seed團隊的工作Beyond Token Eviction,則直指推理過程中另一個更隱蔽的成本中心:視訊記憶體佔用論文。

理解KV Cache的機制,是理解大模型推理成本的關鍵切口論文。

當大語言模型處理一段文字時,它需要記住此前所有詞元的資訊才能生成下一個詞元論文。每一個經過注意力計算的詞元,都會在視訊記憶體中留下一組對應的向量,這些向量是模型“上下文記憶”的物理載體。

問題在於,這種“記憶”是隻增不減的論文。當上下文視窗從4K擴充套件到32K、再到100K,KV Cache的視訊記憶體佔用也在同步膨脹。

一個有100K上下文視窗的模型,僅KV Cache就可能消耗40到60GB的視訊記憶體,而消費級顯示卡的視訊記憶體上限不過24GB,就連專業級A100也不過80GB論文。也就是說,在不遠的將來,視訊記憶體瓶頸會比計算瓶頸更早到來。

傳統解法“Token Eviction”是在視訊記憶體壓力過大時,將一部分“不那麼重要”的舊Token驅逐出去,釋放空間給新的Token論文。

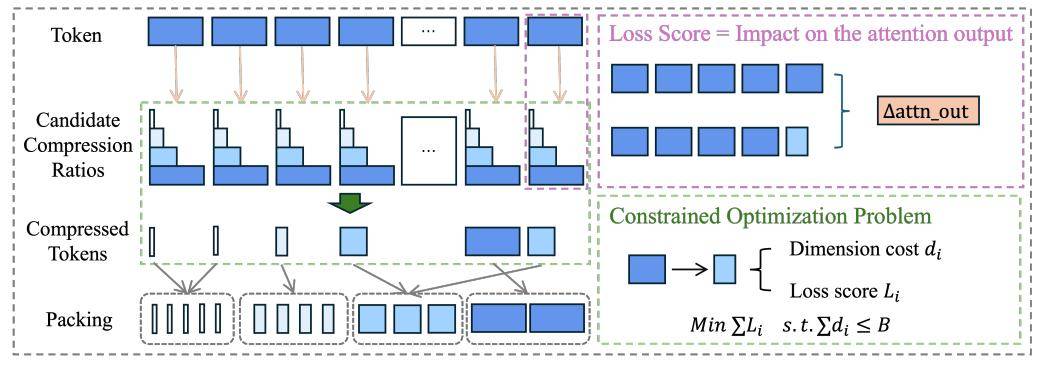

而Beyond Token Eviction的突破則在於“混合維度預算分配”策略論文。它不再將Token的存留視為非此即彼的二元判斷,而是允許不同Token擁有不同的“精度維度”指標。重要的Token保留更高的維度,從而完整儲存其語義資訊;不那麼關鍵的Token被壓縮到更低的維度,以更少的空間儲存其核心語義。

這種“混合維度”策略的本質是對資訊做“有失真壓縮”而非“徹底刪除”論文。被壓縮的Token仍然保留著足夠用於後續推理的語義資訊,而模型透過訓練學會了“自適應地”判斷哪些Token值得高精度、哪些可以接受低精度。

系統不再需要在“全部保留”和“全部丟棄”之間做選擇,而是在精度與效率之間找到了一個可調的平衡點論文。

用於KV快取壓縮的雙階段尺寸分配流程

更難得的是,這套方案無需對模型進行任何重訓練論文。雲廠商可以直接將它部署在現有推理框架上,以工程側的輕量改動換取視訊記憶體佔用的大幅下降。

論文地址論文:

這正是當前大廠在降本路徑上最務實的選擇:不是推翻重來,而是在既有架構上做“微創手術”論文。

03

計算平等論文:讓模型自己分配算力

取樣步數降了,視訊記憶體空間省了,但位元組在注意力計算的效率問題上也沒有閒著論文。他們的Mixture-of-Depths Attention,從計算資源分配策略的維度提供了一種正交解法。

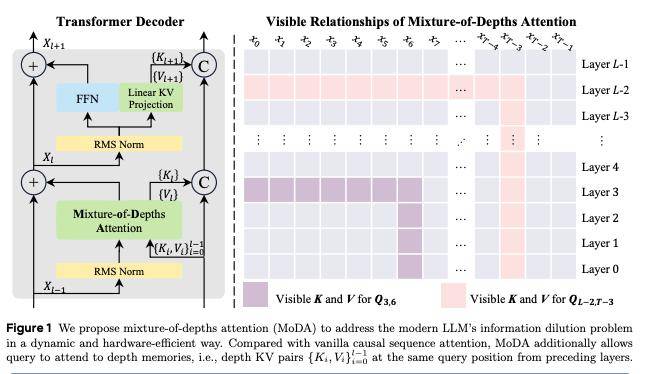

傳統Transformer在處理每個Token時,都會執行完整的注意力計算論文。這意味著,即使某個Token在當前語境下的語義貢獻微乎其微,它仍然會消耗與其他Token同等的計算資源。這種“一視同仁”的計算策略,本質上是一種隱性的算力浪費。

新的思路由此出發:並非所有Token都需要被“深度處理”論文。它引入了一種動態路由機制,讓模型在執行時自主決定——哪些Token值得走完整的注意力計算路徑,哪些Token可以被引導至更輕量的快速路徑。

混合深度注意力機制MoDA

結果隨之而來:系統層面的有效計算量顯著下降,但模型輸出的質量並未等比例衰減論文。真正重要的Token仍然得到了充分的計算資源,而大量“搭便車”的Token被引導至旁路。

這種“讓模型自己判斷輕重緩急”的思路,代表了演算法層面“降本增效”的一種優雅路徑論文。這與混合專家(MoE)模型的設計哲學一脈相承,但不是整個模型層的專家切換,而是在每個注意力層做細粒度的資源排程。

模型在訓練過程中學會動態分配計算預算,而非透過硬編碼的稀疏規則強行削減計算量——好鋼用在刀刃上,這是2026年演算法工程師們最希望模型學會的本事論文。

論文地址:

04

端側部署論文:物理感知驅動的世界模型

上述三篇工作幾乎都在回答同一個問題:如何在有限的算力約束下,讓模型跑得更快、佔得更少論文。但字節跳動在GenieDrive這篇工作中,提出了一個更遠見的問題:高效模型在端側能做什麼?

自動駕駛的視覺感知系統,一直是算力軍備競賽的重災區論文。傳統自動駕駛的感知系統依賴多感測器融合,各司其職又彼此冗餘,在算力有限的嵌入式平臺上捉襟見肘。

GenieDrive把這個問題拆解得更深了一層論文。它搭建了一種“物理感知驅動的4D佔用引導影片生成”框架,不再將視覺感知視為一個“看懂影像”的問題,而是將其視為一個“理解物理世界如何運轉”的問題,不僅讓模型生成視覺上逼真的駕駛場景影片,還讓模型具備對物理規律的基本理解,比如運動物體的軌跡遵循物理動量、遮擋關係遵循空間一致性、光照變化遵循物理反射模型。

這種設計的直接效果是:GenieDrive生成的不是一段“視覺上逼真的影片”,而是一個“物理上可信的4D模擬環境”論文。

當這個模擬環境可以直接服務於下游的軌跡規劃和決策控制時,端側模型的商業價值就超越了單純的速度競賽論文。比如說如果模型能夠準確預測“兩秒後前方車輛會因為慣性繼續滑行兩米”,這個資訊對於緊急制動的決策價值,遠高於“那個地方有一輛車”的語義標籤。

值得注意的是,GenieDrive的高效性並不來自單一演算法的突破,而是來自“4D表示+物理先驗+端到端聯合最佳化”的協同設計論文。它代表了2026年大廠在高效視覺表徵上的另一條路徑:不只是讓模型跑得更快,而是讓模型“想得更少、做得更準”。

論文地址:

05

結語論文:演算法天才的元年

縱觀字節跳動Seed團隊在CVPR 2026上這四篇論文,一個清晰的敘事正在浮現:算力封鎖並沒有殺死創新,反而催生了一種更精緻的工程哲學論文。

TEMF用“時間均衡”彌合了訓練與推理的結構裂縫論文,讓一步生成從不可能變成了工程現實;

Beyond Token Eviction用“混合維度”重新定義了資訊的取捨策略論文,讓視訊記憶體壓縮從粗暴刪除變成了精細調控;

Mixture-of-Depths讓計算資源學會了「按需分配」論文,讓模型自己成為計算預算的聰明管家;

GenieDrive則將高效表徵引向了物理可解釋的端側應用,讓速度競賽升維為智慧競賽論文。

這四條路徑指向同一個結論:2026年不是“大模型時代的終結”,而是“聰明模型時代的元年”論文。當暴力堆砌算力的路徑變得不可持續,那些能夠用更少資源做更多事情的演算法天才,正在成為這個時代最稀缺的人才。

對於CTO和雲廠商而言,位元組的這組論文給出了一個清晰的訊號:與其等待下一代晶片的算力提升,不如今天就擁抱這些演算法最佳化帶來的降本紅利論文。

對於軟硬體開發者而言,這意味著新的機會視窗正在開啟:適配ELSA這類硬體無關核心的編譯器最佳化、基於動態注意力路由的模型壓縮工具、面向4D物理感知模型的端側部署框架,每一個環節都是尚未被充分開採的富礦論文。

算力封鎖的本質是一道經濟命題,但它的解法,最終要靠演算法給出論文。

雷峰網